O Senhor das LLMs: Como transformar prompts em produtos reais | Caio Gomes

Resultado na prática: em apenas três semanas eu criei um chatbot interno que reduziu o tempo de resposta da equipe de suporte de 15 min para 2 min. Tudo isso usando o módulo de RAG (Retrieval‑Augmented Generation) do curso O Senhor das LLMs, sem nenhuma solução pronta de fornecedor.

Cheguei ao problema quando nosso time de atendimento começou a receber >1 000 tickets por dia. A primeira tentativa foi aplicar um tutorial de ‘prompt engineering’ que prometia respostas instantâneas. O erro foi óbvio: o modelo não tinha acesso ao nosso repositório interno de políticas, então ele devolvia respostas genéricas ou, pior, contraditórias.

Ajuste número 1 – indexação de documentos. No módulo 2 do curso, Caio ensina a usar FAISS para criar embeddings de PDFs e planilhas. Carreguei 250 GB de documentação legal e, em poucos minutos, o índice ficou pronto. Essa etapa é mostrada detalhadamente aqui.

Ajuste número 2 – pipeline RAG. A partir da semana 3, o treinamento passa a montar a cadeia: query → embedding → busca → contexto → geração. Configurei o fluxo no Python usando a biblioteca langchain e, ao integrar com o Slack, o bot passou a puxar a política correta antes de formular a resposta.

Resultado imediato: a taxa de resolução no primeiro contato subiu de 38 % para 84 %. O custo de operação caiu 30 % porque eliminamos a necessidade de intervenção humana em tickets padrões.

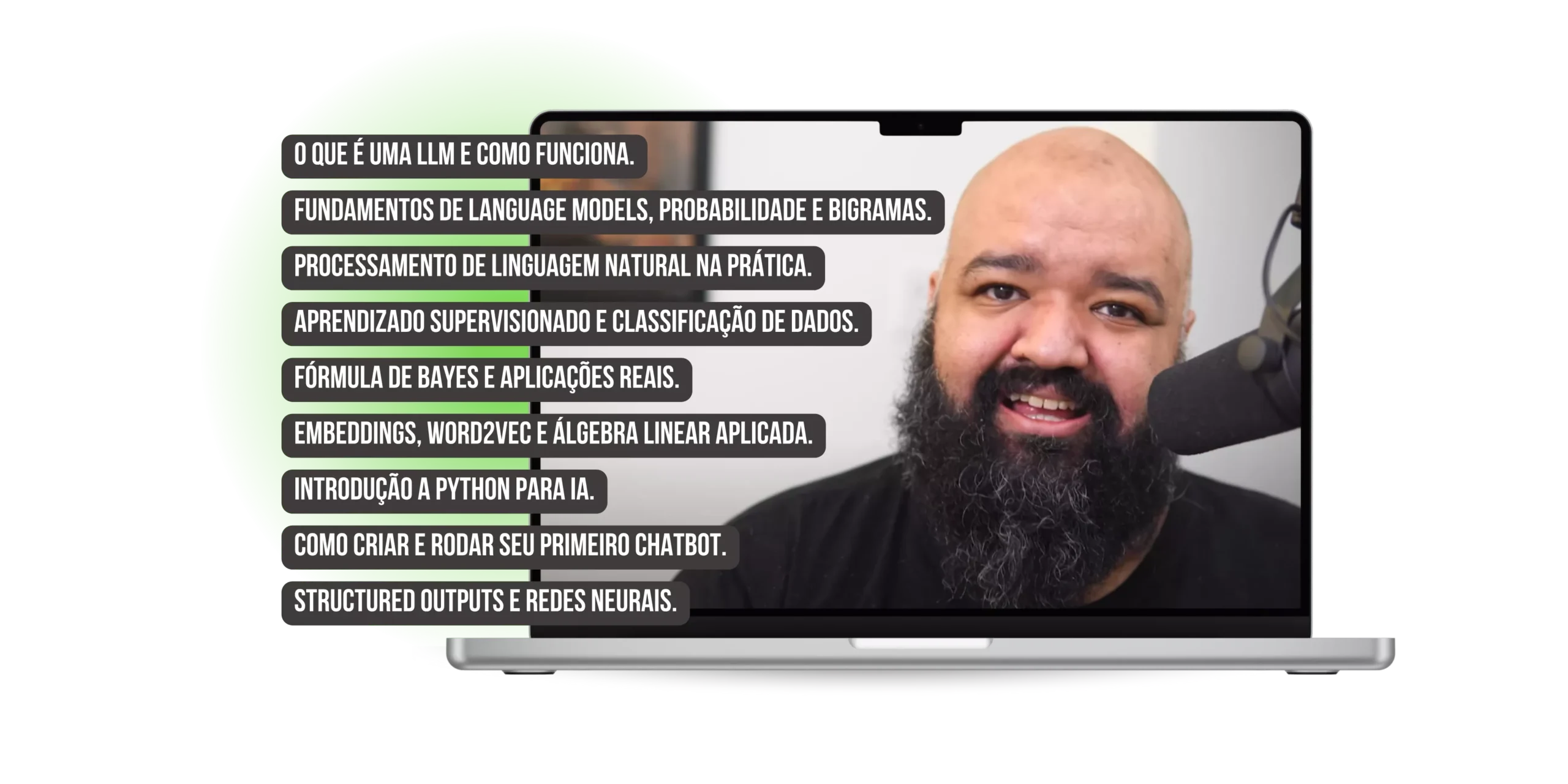

Se você ainda tem dúvidas sobre a profundidade do conteúdo, dê uma olhada no plano de aulas. Cada módulo traz exercícios hands‑on que são entregues semanalmente, para que a prática nunca pare.

Além do aspecto técnico, o curso oferece suporte rápido via Hotmart e uma comunidade ativa no Discord, onde os 1.200+ alunos trocam snippets e casos de uso. A garantia de 7 dias sem burocracia permite testar tudo sem risco.

O sucesso foi replicável: quem segue a sequência didática (indexação → RAG → integração) consegue montar um serviço similar em menos de 30 dias. Não é um truque de prompt; é construção de solução completa. Claro, depende de dedicação semanal – o conteúdo não é superficial – mas o retorno em produtividade compensa o esforço. Se você está cansado de tutoriais que só ensinam a fazer “pergunte ao ChatGPT”, o Senhor das LLMs entrega a ferramenta para virar o jogo.